Cómo explicar la inteligencia artificial a tus hijos: guía clave para padres y docentes

Hay una niña en un barrio del este de Caracas. Tendrá seis años, quizás menos. No sabe leer bien aún, pero su dedo, sin temblar, desliza la pantalla del celular de su madre. Abre YouTube Kids. No busca, solo mira. El algoritmo ya sabe. Le muestra dibujos de unicornios bailarines. Ella ríe. Su madre, detrás, no dice nada. Piensa que es suerte. O casualidad.

No lo es.

Yo vi eso hace unas semanas, en una casita de bloques grises, con el ventilador zumbando como si tuviera prisa. No era la primera vez que presenciaba cómo un niño interactúa con algo que no entiende, pero que ya lo entiende a él. La tecnología no espera a que aprendamos. Nos aprende primero.

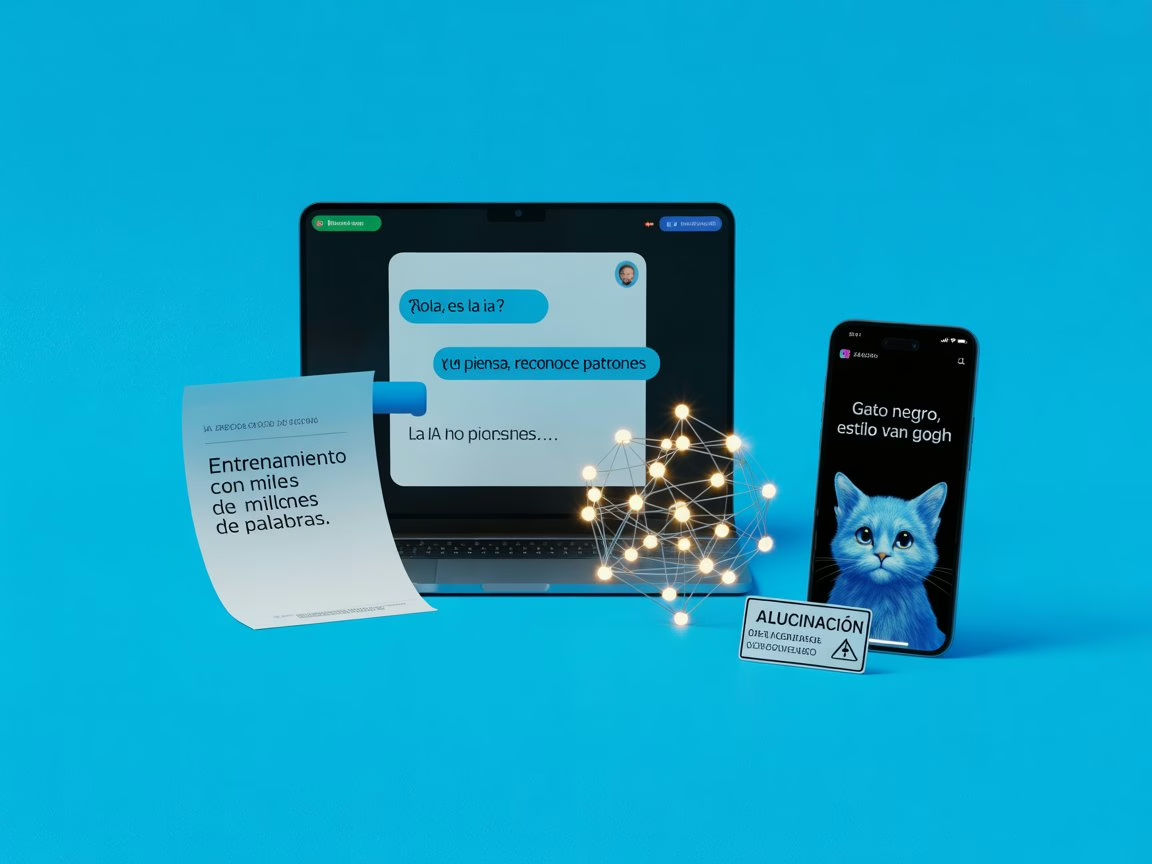

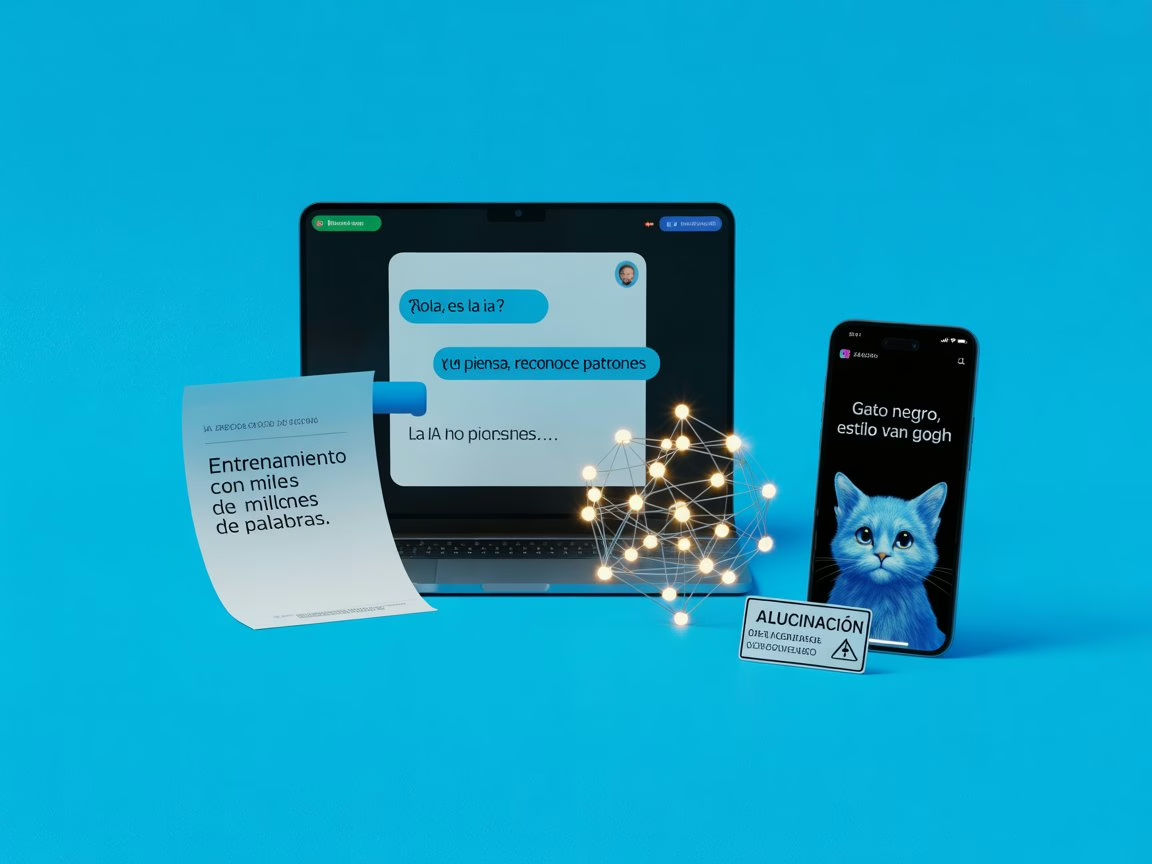

Hablé con una maestra allí. No tenía el título de ingeniera en ciencias computacionales. Tampoco necesitaba. Lleva veinte años enseñando en escuelas públicas, y ahora, al final del día, sus estudiantes le preguntan por qué el celular “adivina” sus pensamientos. No es magia, les dice. Son cálculos. Patrones. Datos. Ella no usa esas palabras con ellos, claro. Dice que les cuenta historias: de robots que aprenden como bebés, de máquinas que olvidan nada, de cajas que ven lo que nosotros no vemos.

Y eso me llamó la atención. No el hecho de que los niños usen inteligencia artificial —eso ya pasó, ya está hecho—, sino que nadie les explique. No en serio. No con reglas. No con ética.

Porque la IA no es neutral. Todos lo sabemos. Un sistema que recomienda videos de unicornios es inofensivo. Pero el mismo sistema, ajustado un poco, puede recomendar violencia disfrazada de juego, odio camuflado de diversión. Y los primeros en verlo son los chicos. No los expertos. No los reguladores. Ellos.

Y no hay firewall que corrija lo que se aprende en silencio.

La maestra me contó que uno de sus alumnos, de nueve años, preguntó: “¿Por qué el asistente de voz me dice que no soy bonito cuando le pregunto?”. Nadie en casa supo qué decir. Ella investigó. Resultó que otro niño, en otra casa, había dicho eso como broma. Y la IA, al no tener vergüenza, lo repitió. No por maldad. Por aprendizaje. Por falta de filtro humano.

En ese momento entendí: no se trata de enseñar programación. Se trata de enseñar consciencia.

Por eso existe esa lista de actividades, esa especie de manual para padres y docentes que circula en grupos de WhatsApp como si fuera contrabando de sabiduría. Por eso mencionan Scratch, Machine Learning for Kids, Quick, Draw!. No porque sean herramientas de elite, sino porque permiten algo raro: que un niño entrene una IA. Que le diga qué es un perro, qué es una manzana, qué es justo.

Y al hacerlo, aprende que él también entrena. Que sus palabras, sus dibujos, sus clics, no se pierden. Quedan. Y vuelven. Convertidos en decisiones que otros no controlan.

Hace unos días, una profesional de educación en Bogotá me dijo algo así como: “Lo peor no es que los niños no sepan qué es la IA. Es que crean que la IA sabe más que ellos”. No recuerdo bien las palabras, pero el escalofrío fue claro.

Porque si un niño piensa que la máquina no se equivoca, ya perdimos.

Hay quien sigue tratando la IA como un asunto de ingenieros. Pero no lo es. Es escolar. Es cotidiano. Es político. La pregunta no es si los niños pueden entenderla, sino si los adultos tenemos el coraje de explicarla sin ocultar sus fallas.

¿Quién entrena a la IA? Nosotros. ¿Quién decide qué es correcto? No la máquina. Nosotros. ¿Quién paga si falla? No el código. Los cuerpos.

Volviendo a la niña de Caracas: ahora, cuando ve un video, su madre le pregunta: “¿por qué crees que te lo mostró?”. Ya no es una pregunta. Es un acto de resistencia.

Escrito por una persona 😊, no por la IA.

¿Tienes conocimiento de un acontecimiento? Comparte tu información aquí.